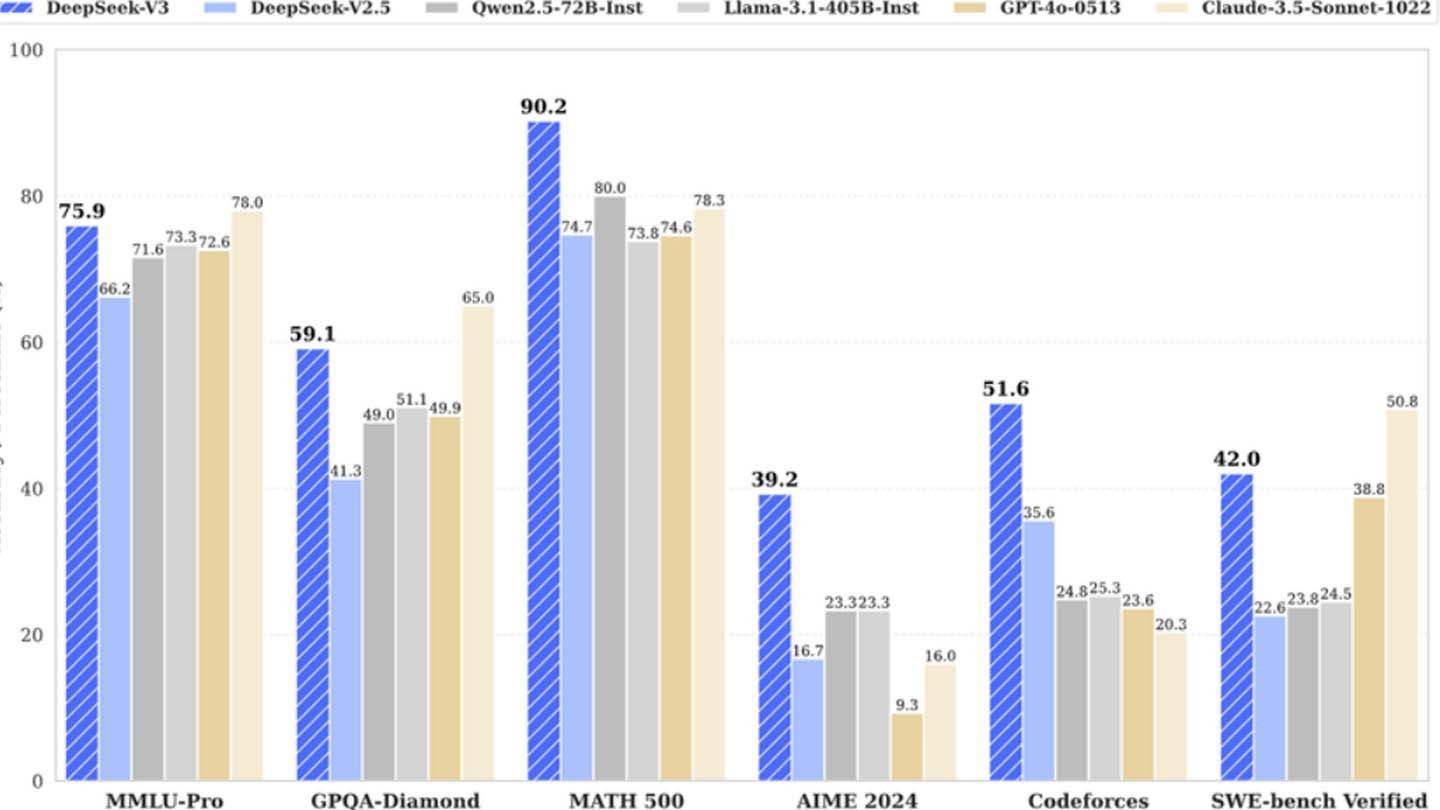

Zaskakująco niedrogi model AI Deepseek wyzwala gigantów branżowych. Firma twierdzi, że przeszkoliła swoją potężną sieć neuronową Deepseek V3 za zaledwie 6 milionów dolarów za pomocą procesorów graficznych 2048, co znacząco podcinając konkurentów. Jednak liczba ta odzwierciedla jedynie koszty GPU przed treningiem, pomijając znaczne badania, udoskonalenie, przetwarzanie danych i wydatki na infrastrukturę.

Obraz: engame.com

Obraz: engame.com

DeepSeek V3 wykorzystuje innowacyjne technologie: Prognozowanie wielofunkcyjne (MTP) w celu poprawy dokładności i wydajności; Mieszanka ekspertów (MOE) , wykorzystująca 256 sieci neuronowych (osiem aktywowanych na token); i wielopłaska ukryta uwaga (MLA) Aby skupić się na kluczowych elementach zdania. Postępy te przyczyniają się do konkurencyjnych wyników modelu.

Obraz: engame.com

Obraz: engame.com

W przeciwieństwie do początkowych twierdzeń, semianaliza ujawniła masową infrastrukturę Deepseek: około 50 000 GPU Nvidia Hopper, w tym jednostki H800, H100 i H20, rozłożone na wiele centrów danych. Całkowita inwestycja serwera szacuje się na 1,6 miliarda USD, a koszty operacyjne wynoszą 944 mln USD. Mimo to Deepseek, spółka zależna od chińskiego funduszu hedgingowego, utrzymuje swoją niezależność i samofinansowanie, wspieranie zwinności i szybkich innowacji.

Obraz: engame.com

Obraz: engame.com

Sukces firmy wynika również z przyciągania najlepszych talentów, a niektórzy badacze zarabiają ponad 1,3 miliona dolarów rocznie. To, w połączeniu z jego szczupłą strukturą, pozwala na skuteczne wdrożenie postępów AI. Całkowita inwestycja w rozwój AI przekracza 500 milionów dolarów.

Obraz: engame.com

Obraz: engame.com

Podczas gdy „przyjazna budżet” narracja Deepseeka jest prawdopodobnie zawyżona, jej przewaga konkurencyjna jest niezaprzeczalna, szczególnie w porównaniu z zgłoszonymi 100 milionami dolarów wydanej na szkolenie Chatgpt4o, w porównaniu z 5 milionami dolarów Deepseek za R1. Sprawa podkreśla potencjał dobrze finansowanych, niezależnych firm AI, aby rzucić wyzwanie uznanym graczom, choć znaczne inwestycje pozostają kluczowym czynnikiem.